слово энтропия что означает

Значение слова «энтропия»

1. Физ. Одна из величин, характеризующих тепловое состояние тела или системы тел; мера внутренней неупорядоченности системы.

2. В теории информации — мера неопределенности какого-л. опыта, который может иметь разные исходы.

[От греч. ’εν — в, на и τροπή — поворот, превращение]

Источник (печатная версия): Словарь русского языка: В 4-х т. / РАН, Ин-т лингвистич. исследований; Под ред. А. П. Евгеньевой. — 4-е изд., стер. — М.: Рус. яз.; Полиграфресурсы, 1999; (электронная версия): Фундаментальная электронная библиотека

Энтропия может интерпретироваться как мера неопределённости (неупорядоченности) некоторой системы, например, какого-либо опыта (испытания), который может иметь разные исходы, а значит, и количество информации. Таким образом, другой интерпретацией энтропии является информационная ёмкость системы. С данной интерпретацией связан тот факт, что создатель понятия энтропии в теории информации (Клод Шеннон) сначала хотел назвать эту величину информацией.

Понятие информационной энтропии применяется как в теории информации и математической статистике, так и в статистической физике (энтропия Гиббса и её упрощённый вариант — энтропия Больцмана). Математический смысл информационной энтропии — это логарифм числа доступных состояний системы (основание логарифма может быть различным, оно определяет единицу измерения энтропии). Такая функция от числа состояний обеспечивает свойство аддитивности энтропии для независимых систем. Причём, если состояния различаются по степени доступности (т. е. не равновероятны), под числом состояний системы нужно понимать их эффективное количество, которое определяется следующим образом. Пусть состояния системы равновероятны и имеют вероятность

ЭНТРОПИЯ

Полезное

Смотреть что такое «ЭНТРОПИЯ» в других словарях:

ЭНТРОПИЯ — (от греч. entropia поворот, превращение), понятие, впервые введённое в термодинамике для определения меры необратимого рассеяния энергии. Э. широко применяется и в др. областях науки: в статистической физике как мера вероятности осуществления к.… … Физическая энциклопедия

ЭНТРОПИЯ — ЭНТРОПИЯ, показатель случайности или неупорядоченности строения физической системы. В ТЕРМОДИНАМИКЕ энтропия выражает количество тепловой энергии, пригодной для совершения работы: чем энергии меньше, тем выше энтропия. В масштабах Вселенной… … Научно-технический энциклопедический словарь

Энтропия — мера внутренней неупорядоченности информационной системы. Энтропия увеличивается при хаотическом распределении информационных ресурсов и уменьшается при их упорядочении. По английски: Entropy См. также: Информация Финансовый словарь Финам … Финансовый словарь

ЭНТРОПИЯ — [англ. entropy Словарь иностранных слов русского языка

Энтропия — Энтропия ♦ Entropie Свойство состояния изолированной (или принимаемой за таковую) физической системы, характеризуемое количеством самопроизвольного изменения, на которое она способна. Энтропия системы достигает максимума, когда она полностью … Философский словарь Спонвиля

ЭНТРОПИЯ — (от греч. entropia поворот превращение) (обычно обозначается S), функция состояния термодинамической системы, изменение которой dS в равновесном процессе равно отношению количества теплоты dQ, сообщенного системе или отведенного от нее, к… … Большой Энциклопедический словарь

энтропия — беспорядок, разлад Словарь русских синонимов. энтропия сущ., кол во синонимов: 2 • беспорядок (127) • … Словарь синонимов

ЭНТРОПИЯ — (от греч. en в, внутрь и trope поворот, превращение), величина, характеризующая меру связанной энергии (D S), которая в изотермическом процессе не может быть превращена в работу. Она определяется логарифмом термодинамической вероятности и… … Экологический словарь

энтропия — и, ж. entropie f., нем. Entropie <гр. en в, внутрь + trope поворот, превращение. 1. Физическая величина, характеризующая тепловое состояние тела или системы тел и возможные изменения этих состояний. Вычисление энтропии. БАС 1. ||… … Исторический словарь галлицизмов русского языка

ЭНТРОПИЯ — ЭНТРОПИЯ, понятие, вводимое в термодинамике и являющееся как бы мерой необратимости процесса, мерой перехода энергии в такую форму, из к рой она не может самопроизвольно перейти в другие формы. Все мыслимые процессы, протекающие в любой системе,… … Большая медицинская энциклопедия

Энтропия — что это такое простыми словами

Что обозначает термин «энтропия»?

Задумывались ли вы когда-нибудь, что означает термин » энтропия»? С помощью этого слова объясняется все, что происходит в жизни (начиная с физических и заканчивая химическими процессами). Мало кто может объяснить, что это значит. Объясняется это тем, что данное явление нельзя наглядно изучить или смерить каким-нибудь прибором.

На самом деле, человечество многое еще не изучило, энтропия является одним из таких явлений. Сотни и сотни лет ученые не могут до конца понять, откуда взялось это явление. Химики и физики » взявшись за руки» пытаются открыть что-то новое по этой теме с помощью различных экспериментов. А в этой статье вы можете узнать, что известно на данный момент.

Как появился этот термин?

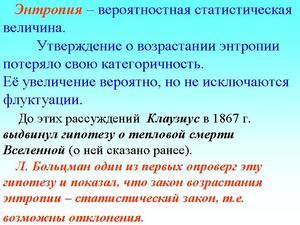

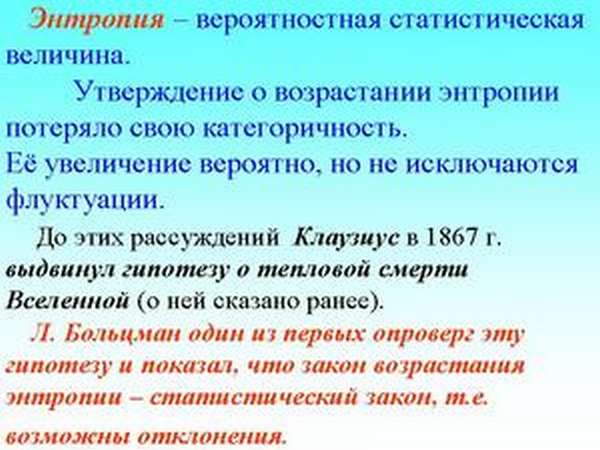

«Энтропию» ввел немецкий физик Р.Клаузис в 1865 г. Дошел он до этого, когда обдумывал один каверзный вопрос. Куда уходит энергия? Все знаем, что кол-во энергии из аккумулятора телефона тратится меньше, чем получается. Для нас это является нормой, а для ученых это была загадка. Этот термин раньше относили только к термодинамике. Однако сейчас оно распространилось на многие области. На данный момент есть много определений, перечислю некоторые из них:

Какие энтропии бывают?

1. В термодинамике.

Каждая система пытается находиться в равновесии и не может сама выйти их него. Состояние равновесия — это беспорядок. Как он определяется? Самый простой метод — это предписание всем состояниям количество вариантов, нужных для реализации этого самого равновесия. Чем больше это значение, тем больше будет энтропия.

2. В экономике.

Коэффициент энтропии нужен для определения изменения её концентрации и уровня рынка. Тут такая зависимость, чем будет выше коэффициент, тем выше неопределенность. С его помощью можно дать оценку выгоде, которую приобрела фирма.

3. В теории информации.

В этой области энтропия помогает узнать уровень беспорядка у эксперимента или какого-либо события. А зависимость, чем больше кол-во состояний, тем больше неопределенность. упорядочивание всегда приводит к увеличению объема информации и к уменьшению неопределенности. Так же с ее помощью можно определить пропускную способность канала, она, в свою очередь, обеспечивает безопасную передачу информации. Так же можно вычислить вероятность какого-нибудь действия и расшифровать почти любой текст.

4. В социологии.

В данном случае энтропия — это характеристика уклона социума от общепринятых норм. его можно обнаружить если снижается развитие и ухудшается самостоятельность. Пример: школьники настолько загружены подготовкой к экзаменам, что просто не способны изучать программу. Тут мерой целесообразных использований будет информационная неопределенность.

Энтропия на простых примерах

Каждый из нас сталкивался с проблемой опечаток в печатном тексте. Что нас обычно спасает? Т9. Она тоже работает по принципу энтропии. Замечали, что, если мало ошибок, программа с легкостью определяет нужный вариант, а если опечаток будет много. она не сможет определить слово. Это происходит потому что увеличение беспорядка (много ошибок) приводит к неопределенности, а порядок к ее отсутствию.

Все любят играть в настольные игры. Чтобы на кубике выпала комбинация 4, нужно два раза по два или один раз 4. этот случай довольно непредсказуем. Энтропию можно считать мерой распределения энергии. При маленьком значении она сконцентрирована, а в высоком хаотична.

Люди, у которых всегда порядок на поверхности рабочего стола могут с легкость найти нужный листик или карандаш потому что неопределенность намного меньше, чем у человека с настоящим хаосом на столе.

На уроке, когда дети сидят упорядоченно каждый на своем месте. у учителя больше информации о каждом. а неопределенность увеличится на перемене, когда увеличится беспорядочность.

Те, кто разбирается в химии, знают, что молекулы газа всегда двигаются беспорядочно. Значит, все реакции, протекающие с выделением газа, например, все известные реакции горения (выделяется угарный газ) будут сопровождены высокой энтропией.

Вывод:

Мы дали множество определений энтропии, выбирайте то, которое вам ближе и понятнее. Добавим, что это так же может быть величина, не преобразованная в механическую работу. Более понятна энтропия в термодинамике (наверное, потому что она в этой области зародилась). Все процессы в природе сопровождаются увеличением энтропии. Интересно заметить, что все в мире хочет добиться максимума энтропии, а человек разумный препятствуя всему и показывая свою индивидуальность, к информации.

Энтропия — что это такое: объяснение термина простыми словами

Энтропия: определение и история появления термина

История появления термина

Энтропия как определение состояния системы была введена в 1865 году немецким физиком Рудольфом Клаузиусом, чтобы описать способность теплоты превращаться в другие формы энергии, главным образом в механическую. С помощью этого понятия в термодинамике описывают состояние термодинамических систем. Приращение этой величины связано с поступлением тепла в систему и с температурой, при которой это поступление происходит.

Определение термина из Википедии

Этот термин долгое время использовался только в механической теории тепла (термодинамике), для которой оно вводилось. Но со временем это определение перешло в другие области и теории. Существует несколько определений термина «энтропия».

Википедия даёт краткое определение для нескольких областей, в которых этот термин используется:«Энтропия (от др.-греч. ἐντροπία «поворот»,«превращение») — часто употребляемый в естественных и точных науках термин. В статистической физике характеризует вероятность осуществления какого-либо макроскопического состояния. Помимо физики, этот термин широко используется в математике: теории информации и математической статистике».

Виды энтропий

Этот термин используется в термодинамике, экономике, теории информации и даже в социологии. Что же он определяет в этих областях?

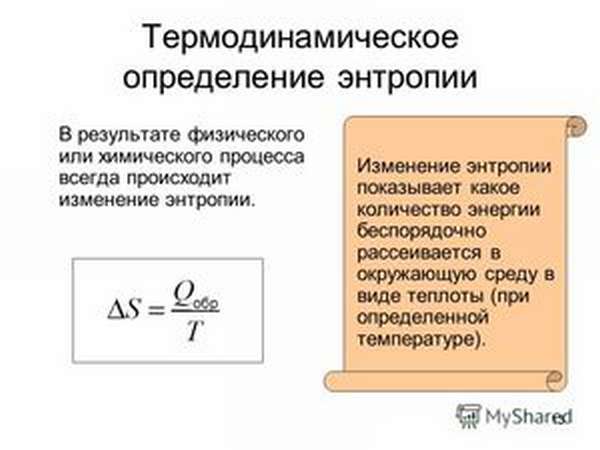

В физической химии (термодинамике)

Энтропия — это мера беспорядка. Как определить беспорядок? Один из способов — приписать каждому состоянию число вариантов, которыми это состояние можно реализовать. И чем больше таких способов реализации, тем больше значение энтропии. Чем больше организованно вещество (его структура), тем ниже его неопределённость (хаотичность).

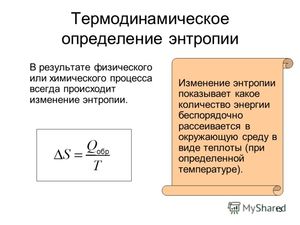

Абсолютное значение энтропии (S абс.) равно изменению имеющейся у вещества или системы энергии во время теплопередачи при данной температуре. Его математическая величина определяется из значения теплопередачи (Q), разделённого на абсолютную температуру (T), при которой происходит процесс: S абс. = Q / T. Это означает, что при передаче большого количества теплоты показатель S абс. увеличится. Тот же эффект будет наблюдаться при теплопередаче в условиях низких температур.

В экономике

В статистической физике или теории информации

Информационная энтропия (неопределённость)— это мера непредсказуемости или неопределённости некоторой системы. Эта величина помогает определить степень беспорядочности проводимого эксперимента или события. Чем больше количество состояний, в которых может находиться система, тем больше значение неопределённости. Все процессы упорядочивания системы приводят к появлению информации и снижению информационной неопределённости.

С помощью информационной непредсказуемости можно выявить такую пропускную способность канала, которая обеспечит надёжную передачу информации (в системе закодированных символов). А также можно частично предсказывать ход опыта или события, деля их на составные части и высчитывая значение неопределённости для каждой из них. Такой метод статистической физики помогает выявить вероятность события. С его помощью можно расшифровать закодированный текст, анализируя вероятность появления символов и их показатель энтропии.

Существует такое понятие, как абсолютная энтропия языка. Эта величина выражает максимальное количество информации, которое можно передать в единице этого языка. За единицу в этом случае принимают символ алфавита языка (бит).

В социологии

Энтропия: тезисно и на примерах

Пример 1. Программа Т9. Если в слове будет небольшое количество опечаток, то программа легко распознает слово и предложит его замену. Чем больше опечаток, тем меньше информации о вводимом слове будет у программы. Следовательно, увеличение беспорядка приведёт к увеличению информационной неопределённости и наоборот, чем больше информации, тем меньше неопределённость.

Пример 2. Игральные кости. Выкинуть комбинацию 12 или 2 можно только одним способом: 1 плюс 1 или 6 плюс 6. А максимальным числом способов реализуется число 7 (имеет 6 возможных комбинаций). Непредсказуемость реализации числа семь самая большая в этом случае.

Пример. Н2О (всем известная вода) в своём жидком агрегатном состоянии будет обладать большей энтропией, чем в твёрдом (лёд). Потому что в кристаллическом твёрдом теле каждый атом занимает определённое положение в кристаллической решётке (порядок), а в жидком состоянии у атомов определённых закреплённых положений нет (беспорядок). То есть тело с более жёсткой упорядоченностью атомов имеет более низкое значение энтропии (S). Белый алмаз без примесей обладает самым низким значением S по сравнению с другими кристаллами.

Пример 2. Чем выше порядок на рабочем столе, тем больше информации можно узнать о вещах, которые на нём находятся. В этом случае упорядоченность предметов снижает энтропию системы «рабочий стол».

Пример 3. Информация о классе больше на уроке, чем на перемене. Энтропия на уроке ниже, так как ученики сидят упорядочено (больше информации о местоположении каждого ученика). А на перемене расположение учеников меняется хаотично, что повышает их энтропию.

Пример. При реакции щелочного металла с водой выделяется водород. Водород-это газ. Так как молекулы газа движутся хаотично и имеют высокую энтропию, то рассматриваемая реакция происходит с увеличением её значения. То есть энтропия химической системы станет выше.

В заключение

Если объединить всё вышесказанное, то получится, что энтропия является мерой беспорядка или неопределённости системы и её частей. Интересен тот факт, что всё в природе стремится к максимуму энтропии, а человек — к максимуму информации. И все рассмотренные выше теории направлены на установление баланса между стремлением человека и естественными природными процессами.

Энтропия что это такое: объяснение термина простыми словами

Энтропия: определение и история появления термина

История появления термина

Энтропия как определение состояния системы была введена в 1865 году немецким физиком Рудольфом Клаузиусом, чтобы описать способность теплоты превращаться в другие формы энергии, главным образом в механическую. С помощью этого понятия в термодинамике описывают состояние термодинамических систем. Приращение этой величины связано с поступлением тепла в систему и с температурой, при которой это поступление происходит.

Определение термина из Википедии

Этот термин долгое время использовался только в механической теории тепла (термодинамике), для которой оно вводилось. Но со временем это определение перешло в другие области и теории. Существует несколько определений термина «энтропия».

Википедия даёт краткое определение для нескольких областей, в которых этот термин используется:«Энтропия (от др.-греч. ἐντροπία «поворот»,«превращение») — часто употребляемый в естественных и точных науках термин. В статистической физике характеризует вероятность осуществления какого-либо макроскопического состояния. Помимо физики, этот термин широко используется в математике: теории информации и математической статистике».

Виды энтропий

Этот термин используется в термодинамике, экономике, теории информации и даже в социологии. Что же он определяет в этих областях?

В физической химии (термодинамике)

Энтропия — это мера беспорядка. Как определить беспорядок? Один из способов — приписать каждому состоянию число вариантов, которыми это состояние можно реализовать. И чем больше таких способов реализации, тем больше значение энтропии. Чем больше организованно вещество (его структура), тем ниже его неопределённость (хаотичность).

Абсолютное значение энтропии (S абс.) равно изменению имеющейся у вещества или системы энергии во время теплопередачи при данной температуре. Его математическая величина определяется из значения теплопередачи (Q), разделённого на абсолютную температуру (T), при которой происходит процесс: S абс. = Q / T. Это означает, что при передаче большого количества теплоты показатель S абс. увеличится. Тот же эффект будет наблюдаться при теплопередаче в условиях низких температур.

В экономике

В статистической физике или теории информации

Информационная энтропия (неопределённость)— это мера непредсказуемости или неопределённости некоторой системы. Эта величина помогает определить степень беспорядочности проводимого эксперимента или события. Чем больше количество состояний, в которых может находиться система, тем больше значение неопределённости. Все процессы упорядочивания системы приводят к появлению информации и снижению информационной неопределённости.

С помощью информационной непредсказуемости можно выявить такую пропускную способность канала, которая обеспечит надёжную передачу информации (в системе закодированных символов). А также можно частично предсказывать ход опыта или события, деля их на составные части и высчитывая значение неопределённости для каждой из них. Такой метод статистической физики помогает выявить вероятность события. С его помощью можно расшифровать закодированный текст, анализируя вероятность появления символов и их показатель энтропии.

Существует такое понятие, как абсолютная энтропия языка. Эта величина выражает максимальное количество информации, которое можно передать в единице этого языка. За единицу в этом случае принимают символ алфавита языка (бит).

В социологии

Энтропия: тезисно и на примерах

Пример 1. Программа Т9. Если в слове будет небольшое количество опечаток, то программа легко распознает слово и предложит его замену. Чем больше опечаток, тем меньше информации о вводимом слове будет у программы. Следовательно, увеличение беспорядка приведёт к увеличению информационной неопределённости и наоборот, чем больше информации, тем меньше неопределённость.

Пример 2. Игральные кости. Выкинуть комбинацию 12 или 2 можно только одним способом: 1 плюс 1 или 6 плюс 6. А максимальным числом способов реализуется число 7 (имеет 6 возможных комбинаций). Непредсказуемость реализации числа семь самая большая в этом случае.

Пример. Н2О (всем известная вода) в своём жидком агрегатном состоянии будет обладать большей энтропией, чем в твёрдом (лёд). Потому что в кристаллическом твёрдом теле каждый атом занимает определённое положение в кристаллической решётке (порядок), а в жидком состоянии у атомов определённых закреплённых положений нет (беспорядок). То есть тело с более жёсткой упорядоченностью атомов имеет более низкое значение энтропии (S). Белый алмаз без примесей обладает самым низким значением S по сравнению с другими кристаллами.

Пример 2. Чем выше порядок на рабочем столе, тем больше информации можно узнать о вещах, которые на нём находятся. В этом случае упорядоченность предметов снижает энтропию системы «рабочий стол».

Пример 3. Информация о классе больше на уроке, чем на перемене. Энтропия на уроке ниже, так как ученики сидят упорядочено (больше информации о местоположении каждого ученика). А на перемене расположение учеников меняется хаотично, что повышает их энтропию.

Пример. При реакции щелочного металла с водой выделяется водород. Водород-это газ. Так как молекулы газа движутся хаотично и имеют высокую энтропию, то рассматриваемая реакция происходит с увеличением её значения. То есть энтропия химической системы станет выше.

В заключение

Если объединить всё вышесказанное, то получится, что энтропия является мерой беспорядка или неопределённости системы и её частей. Интересен тот факт, что всё в природе стремится к максимуму энтропии, а человек — к максимуму информации. И все рассмотренные выше теории направлены на установление баланса между стремлением человека и естественными природными процессами.